개요

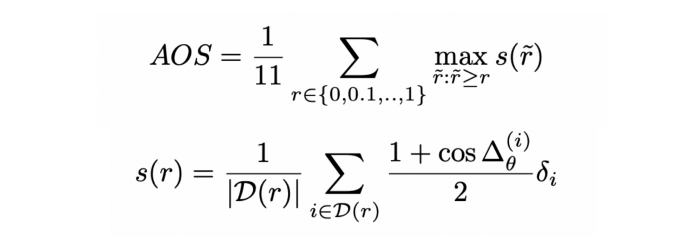

- KITTI 방향 감지 성능에 대한 공식 등급 지표입니다.

- 원천 : https://towardsdatascience.com/orientation-estimation-in-monocular-3d-object-detection-f850ace91411

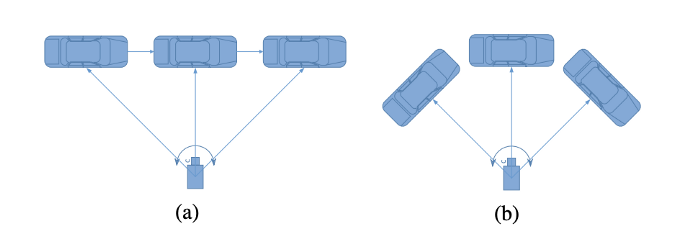

- 자동차의 전역 방향은 모두 오른쪽을 가리키지만 자동차가 왼쪽에서 오른쪽으로 이동함에 따라 로컬 방향과 모양이 변경됩니다.

- b에서 자동차의 전체 방향은 다르지만 카메라 좌표의 로컬 방향과 모양은 모두 변경되지 않습니다.

KITTI는 롤과 피치를 0으로 가정하기 때문에 방향을 간단히 요(yaw)로 표현한다.

로컬에서 글로벌 요까지

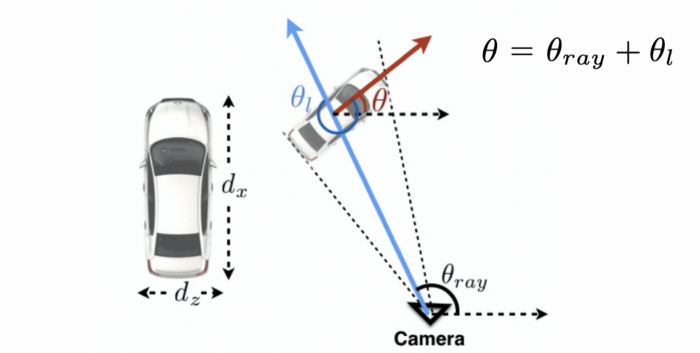

- 글로벌 요와 로컬 요를 구별하려면 카메라와 물체 사이의 빔 방향을 알아야 합니다.

- 광선 방향을 알기 위해서는 경계 상자와 고유 행렬(초점 및 초점 거리) 점 값을 알아야 합니다.

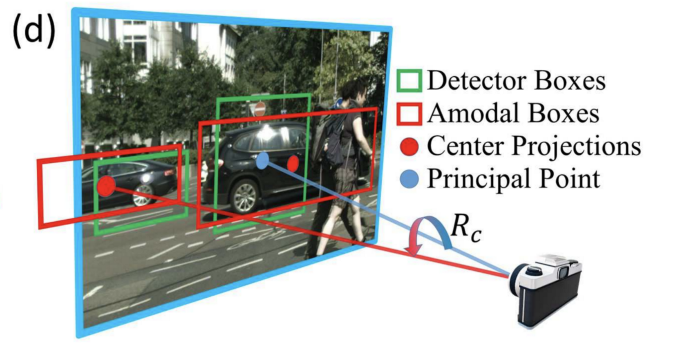

- 경계 상자와 관련된 선택 가능한 변수

- 감지기 상자 중간(잘라낼 수 있음)

- 모달 상자의 중심(가리거나 잘린 개체의 예상 범위 포함)

- 3D 경계 상자를 이미지에 투영(Lidar 3D 경계 상자 지상 실측에서 얻을 수 있음)

- 2D 경계 상자의 하단 중앙(종종 지면에 있는 것으로 가정)

차량이 매우 가깝거나 심하게 잘리거나 잘 보이지 않는 한 위의 절차는 약 1-2도의 각도 추정치를 제공해야 합니다.

AOS 받기

KITTI는 다음 두 가지 각도를 제공합니다.

- alpha : 물체의 관찰각도, 범위(-pi, pi)

- rotation_y : 카메라 좌표에서 y축을 중심으로 한 회전(-pi, pi)

위의 두 각도는 로컬(allocentric) yaw와 글로벌(egocentric) yaw입니다.

LiDAR 데이터를 기반으로 3D Bounding Box Ground Truth에서 추정한 결과로 보입니다.

이를 통해 2D 이미지에서 각도 추정을 쉽게 수행할 수 있습니다.

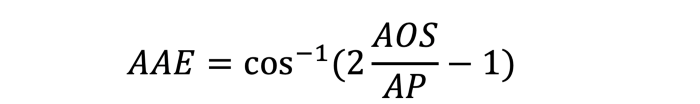

AAE(Average Angular Error)라는 3D RCNN에 의해 대중화된 메트릭도 있습니다.

한 걸음 더 나아가

- 로컬(allocentric) 방향(yaw)은 로컬 이미지 섹션에서 추정할 수 있습니다.

- 로컬 이미지 섹션에서 전역(자기 중심) 방향(yaw)을 추정하는 것은 불가능합니다.

- 카메라 고유의 속성과 이미지 섹션의 전역 정보를 사용하여 로컬 yaw를 전역 yaw로 변환할 수 있습니다.

- 관점 방향 회귀는 딥러닝에서 가장 어려운 회귀 문제 중 하나입니다.

https://towardsdatascience.com/anchors-and-multi-bin-loss-for-multi-modal-target-regression-647ea1974617

다중모달 회귀 – L1 및 L2 손실 너머

다중 모달 대상 회귀에 대한 다중 빈 손실

datascience.com을 향해